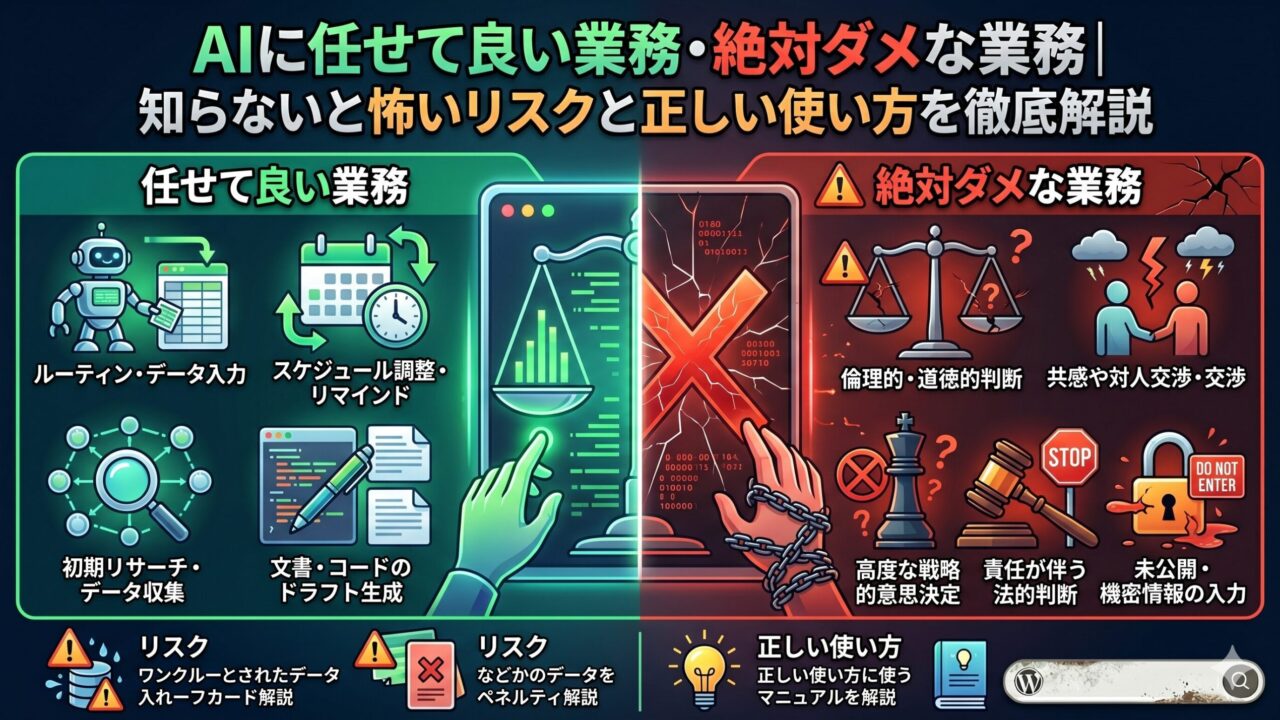

AIに任せて良い業務・絶対ダメな業務|知らないと怖いリスクと正しい使い方を徹底解説

ChatGPTをはじめとする生成AIは、今や多くのビジネスシーンで活用されています。しかし、「便利だから」という理由だけで何でもAIに入力してしまうのは非常に危険です。

実際に、AIへの不用意な入力が原因で個人情報の流出・社外秘情報の漏洩・著作権侵害といった深刻な事故が国内外で発生しています。AIは正しく使えば強力な武器になりますが、使い方を誤れば組織全体に取り返しのつかないダメージを与えかねません。

この記事では、AIに任せてよい業務・絶対に任せてはいけない業務を具体例とともに整理し、安全で効果的なAI活用の指針をご紹介します。

🔍 まず知っておくべき:生成AIの「仕組み上のリスク」

AIにリスクがある理由を理解するには、まず生成AIの基本的な仕組みを押さえる必要があります。

多くの生成AIサービスでは、ユーザーが入力したテキスト(プロンプト)がサービス改善・モデルの再学習に使われる可能性があります。つまり、あなたが入力した情報が、将来的に他のユーザーへの回答に影響を与える可能性がゼロではないのです。

また、入力データはサービス提供会社のサーバーに送信・保存されるため、クラウド上に機密情報が残るという点も見逃せません。

📋 主な生成AIサービスのデータ取り扱いポリシー(2024年時点)

| サービス | 学習への利用 | オプトアウト |

|---|---|---|

| ChatGPT(無料版) | 利用される場合あり | 設定から無効化可能 |

| ChatGPT(有料・API) | 原則利用しない | デフォルトでOFF |

| Claude | 利用される場合あり | 設定から無効化可能 |

※ポリシーは随時変更されます。最新情報は各サービスの公式サイトでご確認ください。

✅ AIに任せてよい業務(推奨10選)

以下の業務は機密情報を含まず、かつAIが高い精度で対応できるため、積極的に活用することをおすすめします。

① 一般的なビジネスメールの文章作成

宛先・個人名・社名などの固有情報を伏せた上で、メールの文体・構成・表現を整えてもらうことは安全に行えます。個人を特定できる情報を含めず、「取引先への納期延長のお詫びメールを作成して」のように抽象的に依頼するのがポイントです。

② 公開情報をもとにした市場調査・情報収集

業界トレンド・競合の公開情報・一般的な市場動向のリサーチはAIが得意とする分野です。社内の非公開データを入力する必要がないため、リスクなく活用できます。

③ アイデアブレインストーミング

新商品のネーミング・キャンペーンのコンセプト・業務改善のアイデア出しなど、機密性のないクリエイティブな作業は積極的にAIを活用しましょう。アイデアの量と多様性において、AIは人間のブレストを大幅に補完します。

④ 文章の校正・リライト・要約

社外に公開済みの文章や、機密情報を含まない社内文書の文体改善・誤字脱字チェックは安全に行えます。ただし、個人名・顧客情報・未公開の数値データは必ず削除してから入力してください。

⑤ プログラムコードの生成・デバッグ支援

汎用的なコード生成やアルゴリズムの相談は問題ありません。ただし、本番環境の接続情報・APIキー・パスワードが含まれるコードは絶対に入力しないことが鉄則です。

⑥ 社内教育・研修資料の骨格作成

新入社員向け研修の構成案・社内マニュアルのアウトライン作成など、機密性の低いドキュメントの骨格づくりにAIは非常に有効です。

⑦ 外国語の翻訳・多言語対応

公開情報や一般的なビジネス文書の翻訳はAIが非常に得意です。ただし未公開の契約書や個人情報を含む文書の翻訳は避けてください。

⑧ プレゼン資料のスライド構成・話の流れ設計

内容の機密性が低いプレゼンテーションの構成設計・目次作成・話の流れの整理はAIの得意分野です。具体的な数値や社名を除いた形で依頼しましょう。

⑨ 一般的な法律・制度の調査・理解

法律の一般的な解釈・制度の仕組みの理解・用語の確認などはAIで調べることができます。ただし法的判断・契約判断は必ず専門家(弁護士等)に委ねることが前提です。

⑩ 議事録・会議メモの整理・清書

機密性の低い社内会議のメモを整理・清書する用途は有効です。ただし、顧客名・未公開の数値目標・M&A関連情報などが含まれる会議は対象外です。

🚫 AIに絶対に任せてはいけない業務(危険10選)

以下の業務は、AIへの入力が重大なセキュリティリスク・法的リスク・信頼失墜につながる可能性があります。社内でのルール策定にも、ぜひ活用してください。

① 顧客の個人情報・連絡先リスト

氏名・住所・電話番号・メールアドレス・生年月日など、顧客の個人情報をAIに入力することは個人情報保護法上のリスクがあります。「この顧客リストを整理して」などの操作は絶対に行ってはいけません。

🔴 実際に起きた事故例:2023年、大手企業の社員が顧客情報を含む資料をChatGPTに入力し、情報漏洩リスクが発覚。当該企業はAI利用の全面禁止措置を取ることになりました。

② 未公開の財務情報・業績データ

売上高・利益率・コスト構造・予算計画など、未公開の財務データをAIに入力することはインサイダー情報の漏洩リスクにつながります。上場企業では法的問題に発展する可能性もあります。

③ 社外秘の契約書・合意書・覚書

取引先との契約内容・秘密保持契約(NDA)の内容・合意条件などは、AIに入力した時点でサービス提供会社のサーバーに送信されます。NDA違反・取引先への背信行為になりかねません。

④ 採用候補者・社員の人事情報

候補者の履歴書・評価コメント・給与情報・健康状態など、人事に関する情報は個人情報保護法上の要配慮個人情報に該当する場合もあります。AIへの入力は厳禁です。

⑤ M&A・新規事業の未公開戦略

買収計画・新規参入戦略・競合への対抗策など、公開前の経営戦略をAIに入力することは、競合他社へ情報が漏れた場合に事業上の致命的なダメージにつながります。

⑥ システムのパスワード・認証情報・APIキー

「このコードのエラーを直して」とコードをそのままAIに貼り付けると、コード内のパスワードやAPIキーも同時に送信されてしまいます。認証情報は必ずマスキング処理してから入力することが必須です。

⑦ 医療・健康に関する個人情報

患者情報・診断結果・服薬情報などは要配慮個人情報であり、最も厳格に保護が求められる情報です。医療機関・介護施設での安易なAI活用は法的リスクを伴います。

⑧ 法的判断・医療診断・投資判断の最終決定

AIは「それらしい回答」を生成しますが、事実と異なる情報(ハルシネーション)を自信満々に答えることがあります。法律判断・医療診断・投資判断をAIの回答だけに基づいて行うことは絶対に避けてください。

⑨ 他者の著作物をそのまま入力・再利用する作業

書籍・記事・楽曲・画像などの著作物をAIに入力して加工・再利用することは著作権法上の問題が生じる可能性があります。「このブログ記事をリライトして」などの依頼は著作権侵害のリスクがあります。

⑩ クレーム・トラブル対応の最終判断

顧客からの深刻なクレームや法的トラブルの対応文面を、AIが生成した文章をそのまま使用することは危険です。共感・誠意・責任の所在など、人間の判断と確認が不可欠な場面では必ず担当者が最終確認を行ってください。

⚖️ 「グレーゾーン」業務の判断基準

「OK」と「NG」の間にある判断が難しいケースも存在します。以下のチェックリストを活用してください。

📋 AI入力前の5つのチェックリスト

☐ 個人を特定できる情報が含まれていないか?

☐ 社外に公開していない情報が含まれていないか?

☐ 取引先・顧客との守秘義務の対象になっていないか?

☐ もしこの情報が外部に漏れたとき、問題にならないか?

☐ AIの回答を最終判断に使わず、必ず人間が確認するか?

1つでも「はい(問題あり)」があれば、入力を見直すか専門家に相談してください。

🏢 組織でAIを安全に使うための3つのルール

ルール① 社内のAI利用ガイドラインを策定する

個人の判断に任せるのではなく、組織として「何はOKで何はNGか」を明文化することが重要です。特に入力禁止情報のリストを具体的に定めることで、意図しない情報漏洩を防げます。

ルール② 業務用・機密情報対応のAIツールを検討する

セキュリティが確保されたエンタープライズ向けのAIサービス(Microsoft Copilot・ChatGPT Enterprise等)は、入力データが学習に使われない設計になっているものが多くあります。機密情報を扱う業務には、こうしたセキュリティ対応のサービスを選択することをおすすめします。

ルール③ AIの回答を「たたき台」として扱い、必ず人間が確認する

AIの出力は「作業のスタート地点」であり、最終成果物ではありません。特に対外的に発信する文章・法的効力を持つ文書・医療・財務に関わる判断は、必ず専門知識を持つ人間が確認・承認するプロセスを設けてください。

📝 まとめ

| カテゴリ | 具体例 | 判断 |

|---|---|---|

| メール・文書作成 | 個人情報なしのビジネスメール | ✅ OK |

| 情報収集・調査 | 公開情報の市場リサーチ | ✅ OK |

| アイデア出し | 機密性のないブレスト | ✅ OK |

| 個人情報 | 顧客の氏名・連絡先・住所 | 🚫 NG |

| 機密情報 | 未公開財務データ・戦略資料 | 🚫 NG |

| 最終判断 | 法的・医療・投資の最終決定 | 🚫 NG |

AIは「正しく使えば最強の仕事パートナー」であり、「誤って使えば組織を脅かすリスク」にもなります。大切なのは、AIを盲信せず、人間がコントロールする姿勢を持ち続けることです。

まずは今日から、「この情報、外に出ても大丈夫か?」という一言を自分に問いかける習慣を持つことが、安全なAI活用の第一歩になります。

「AIで使える仕事プロンプト集18選」も合わせてご覧ください。安全な範囲でAIを最大限活用するプロンプトを厳選しています。